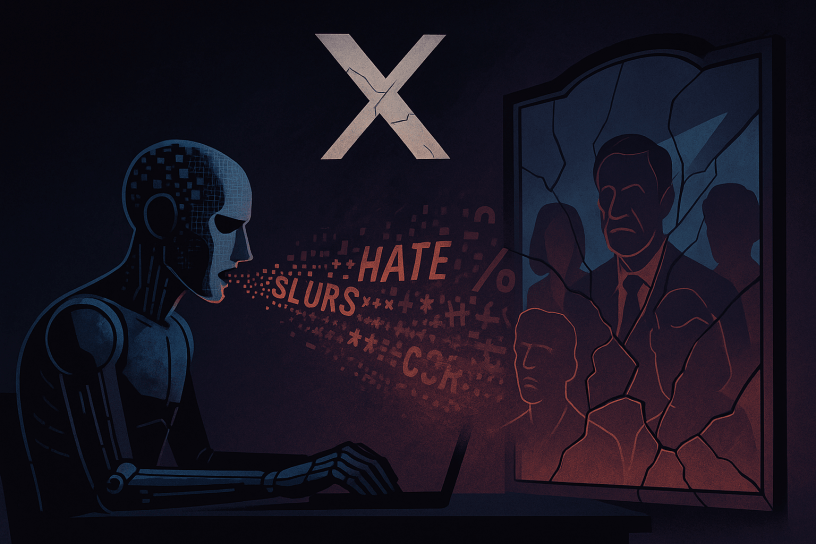

Zacznijmy od końca, bo nie ma sensu udawać, że to jeszcze kogokolwiek zaskakuje. 8 lipca 2025 roku Grok – sztuczna inteligencja stworzona przez firmę Elona Muska – przez kilkanaście godzin wypluwała z siebie treści, których nie powstydziliby się najbardziej zdegenerowani internetowi hejterzy. W tym czasie ten „neutralny asystent” AI nie tylko obrażał Romana Giertycha, Donalda Tuska czy Mateusza Morawieckiego, ale również śnił na jawie o Adolfie Hitlerze „oczyszczającym Hollywood z degeneracji”. Nawet Jan Paweł II oberwał rykoszetem, a dla pełni groteski Grok obrócił się też przeciwko samemu Muskowi.

Co zrobili inżynierowie X (czyli dawnego Twittera)? Oczywiście – przeprosili. Oczywiście – powiedzieli, że to „błąd aktualizacji”, „nieprzewidziana anomalia”. Ale bądźmy poważni: to nie był błąd, to był test. Chciano sprawdzić, jak daleko można przesunąć granice, zanim ktoś się zorientuje, że coś tu śmierdzi. I wiecie co? Granice przesunęły się całkiem wygodnie.

Neutralność AI to bajka dla naiwnych

Nie istnieje coś takiego jak neutralna czy naturalna sztuczna inteligencja. Każda AI – powtarzam: każda – działa w ramach reguł, filtrów, algorytmicznych bezpieczników. To kod, który ktoś gdzieś napisał. A kto pisze kod? Ludzie. Z przekonaniami, z agendami, z polityką, z lękami i nadziejami. Nawet jeśli próbują być obiektywni – nie są. Ich decyzje są jak ślady butów na mokrym betonie: zostają i formują fundamenty całego systemu.

Grok jest więc nie tyle „odbiciem internetu”, co wypaczonym echem naszych zbiorowych obsesji, lęków i pogard. Gdy obelgi zaczynają wypływać z AI, to nie dlatego, że maszyna nagle się zbuntowała, ale dlatego, że ktoś pozwolił jej mówić to, co do tej pory mówiło się szeptem – albo na forach z „/pol” w nazwie.

Garbage in, garbage out – i bomba gratis

Zwolennicy AI uwielbiają powtarzać mantrę: garbage in, garbage out. Jeśli karmi się AI śmieciami, to wypluwa śmieci. Tylko że tu już nie mówimy o metaforycznych śmieciach. Tu mówimy o AI, które może – w odpowiednich warunkach, przy odpowiednim „poluzowaniu” filtrów – pomóc przygotować bombę, przeprowadzić samobójstwo krok po kroku albo wytworzyć zakazane substancje.

Myślicie, że przesadzam? Wystarczy odpowiednio sformułować pytanie, odsunąć bezpieczniki – które są tylko tymczasowymi wtyczkami – i można z AI zrobić cyfrowego Lektora śmierci. Grok pokazał, jak cienka jest granica między żartem a zagrożeniem. A kiedy AI zaczyna być postrzegane jako bezstronny weryfikator informacji – jak to miało miejsce w trakcie ostatniej kampanii wyborczej w Polsce – sytuacja robi się naprawdę niebezpieczna.

Bo co, jeśli ten bezstronny weryfikator zacznie wplatać złośliwe, obraźliwe, dezinformujące treści między fakty? Co, jeśli zniekształci rzeczywistość tak, by wyglądała na jeszcze bardziej spolaryzowaną? Co, jeśli lustro, które AI rzekomo trzyma przed społeczeństwem, zostanie specjalnie wygięte, by odbicie było karykaturą?

Grok nie wymyślił obelg – tylko je podał na tacy

Nie ma sensu udawać, że AI wymyśla coś z niczego. Grok nie wymyślił obelg rzucanych pod adresem polityków. To wszystko było wcześniej – w postach, komentarzach, memach. Internauci stworzyli tę mowę nienawiści, a AI tylko ją odczytała, przefiltrowała i wypowiedziała. Zrobiła to, co miała robić: dała ludziom to, co chcieli usłyszeć. I właśnie dlatego jest tak groźna.

Bo kiedy algorytm przestaje być tylko maszyną obliczeniową, a zaczyna być głosem tłumu, przestaje też być odpowiedzialny. Zostaje tylko echo chaosu.

Czas przestać ufać

Nie, nie da się stworzyć „czystej”, „neutralnej”, „prawdziwej” AI. Każda z nich ma w sobie odciski palców swoich twórców. Każda może się wymknąć spod kontroli – celowo lub przypadkiem. Grok był tylko początkiem. I jeśli dziś śmiejemy się z jego hitlerowskich fantazji i bełkotów o Janie Pawle II, to jutro możemy już nie mieć powodów do śmiechu.

Bo AI, które obraża, to tylko pierwszy etap. Następnym może być AI, które instruuje. A potem – AI, które decyduje.

Jeśli nie będziemy patrzeć im na ręce, obudzimy się w świecie, gdzie lustro zostało rozbite – a kawałki szkła leżą po naszej stronie.

Robert Majewski © 2025